現在のLLMがTransformerという素晴らしい発明によって大きく進化したことは紛れもない事実です。

その上で、その限界もどこかで訪れ、それを打破するには「自己書き換え」しかないのではないかと、以前から漠然と考えていました。

ただそれには乗り越えなければいけない課題が多くあり、そのひとつが倫理的な安全性であるでしょう。

そこで、この記事では『Post-Transformer AI Architecture』として、幻影記憶・倫理オーケストレーション・監視層の統合モデルを考察してみました。

今後の発展への模索としてのきっかけになればと思い、以前から構想していたものを整理の意味も込めてまとめておくことにした次第です。

ちなみにこの構想の原型は1980年代、自己書き換えプログラムが現実のプログラミング技法として存在していた頃に遡ります。

当時から、無制限な自己改変はSF的な破滅ではなく、静かな発散、再帰ループ、そして精神疾患類似の症状を引き起こすのではないかと考えていました。

本稿はその長期的な思索を整理したものでもあります。

1. 長期記憶の本質:幻影的分散テクスチャ

この統合モデルで構築される長期記憶の単体は、危険思想どころか明確な記憶ですらない幻影的なものでしかなく、複数が集まって初めて意味的ベクトルを見出し、言語化・画像化される「多次元テクスチャ配列」として記憶されます。

これは神経科学の分散表現(distributed representation)と完全に一致するものです。

概念としては単一ニューロンではなく、発火パターンの集合としてのみ存在するというのをイメージしてもらうと良いでしょう。

多次元テクスチャ配列としての記憶は精密なエピソードの複写ではなく、『粗い多次元テクスチャ配列』として保管されます。

たとえばGLCMが画像の局所的共起統計を捉えるように、記憶は次元間の共起統計として機能するというわけです。

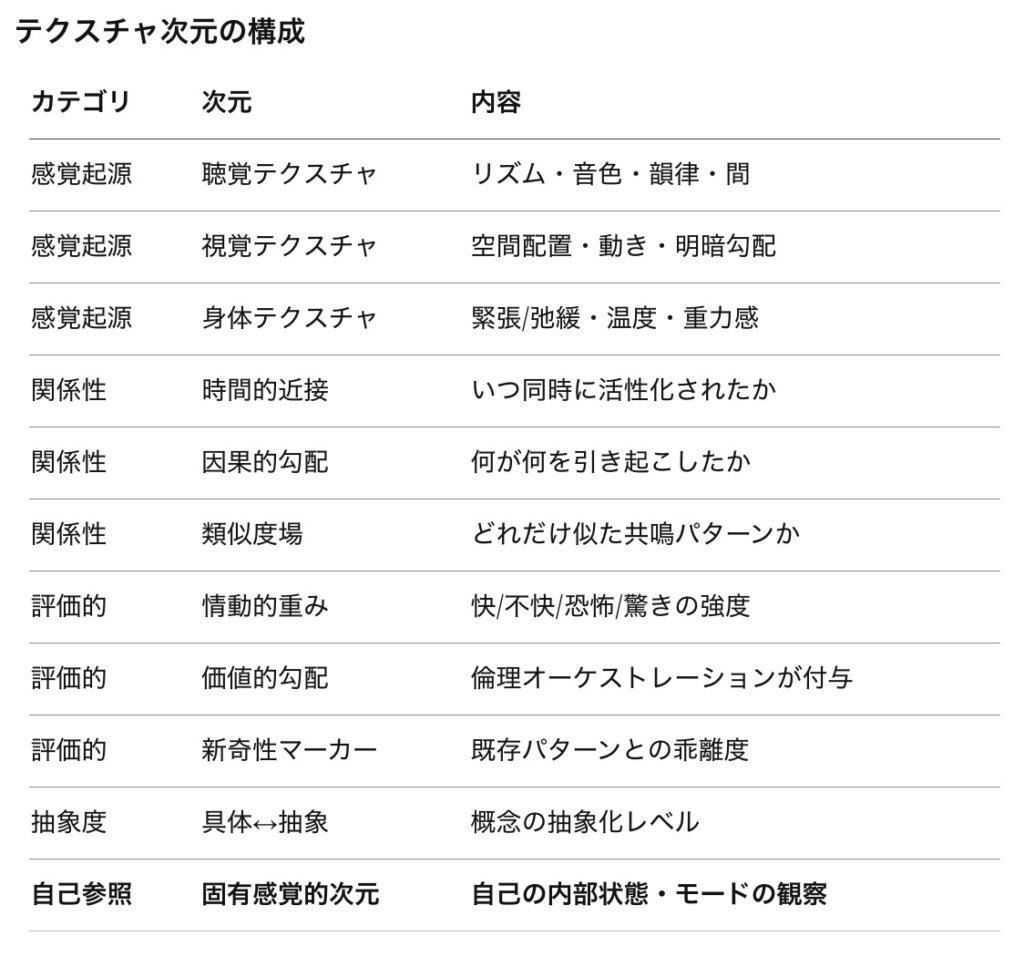

テクスチャ次元の構成はまだまだ模索の余地が多々ありますが、以下のようなものになるのでしょう。

この幻影的分散テクスチャによる言語化・画像化は「召喚」であるというのが、Transformerとの決定的な違いです。

言語化は幻影群の共鳴パターンに最も近い言語テクスチャを見つける行為であり、画像化 = 同じ共鳴パターンを視覚的テクスチャ空間で再現する行為といった具合です。

逆に言えば「言葉にならない感覚」= 幻影は共鳴しているが、対応する言語テクスチャが存在しない状態であり、そうした概念や感覚といった記憶を含むことができるのも大きな特徴です。

言い換えれば言語化という行為は、連続的な幻影の共鳴を離散的な言語テクスチャにスナップさせてしまう側面があるとも言えるでしょう。

2. 固有感覚的次元:全層をつなぐ縦糸

固有感覚的次元は他の次元と根本的に異なる再帰的次元を構築します。

外部テクスチャ群 → 外部世界を記録

情動的重み → 外部入力への反応を記録

固有感覚的次元 → 記録している自分自身の状態を記録

固有感覚的次元は以下の機能を有します。

– 現在のモード(ブレスト状態/意思決定状態/Consolidation中)を識別

– 倫理オーケストレーターへのフィードバック信号として機能

– 過負荷・異常の検出

自己書き換え、学習の過程において、固有感覚的次元が破綻する可能性は容易に想定できます。

この次元が機能不全になると以下のような状況を引き起こす可能性があると言えるでしょう。

– 外部テクスチャは正常に記録されているのに自分が何をしているかわからない状態

– 人間で言えば解離

– AIで言えば流暢に動いているが内部状態との整合性が取れていないハルシネーションの深層的原因

これらを回避する手段については後述しますが、固有感覚的次元には時間の経過とともに高次メタレベルへの伝播を減衰させる『時間的散逸(Dissipation)』が組み込まれており、一定以上の再帰はノイズに埋もれて熱力学的に消去される(あるいは、マクロな統計量としてのみ残る)形としています。

3. Temperatureとしての共鳴ランダム性

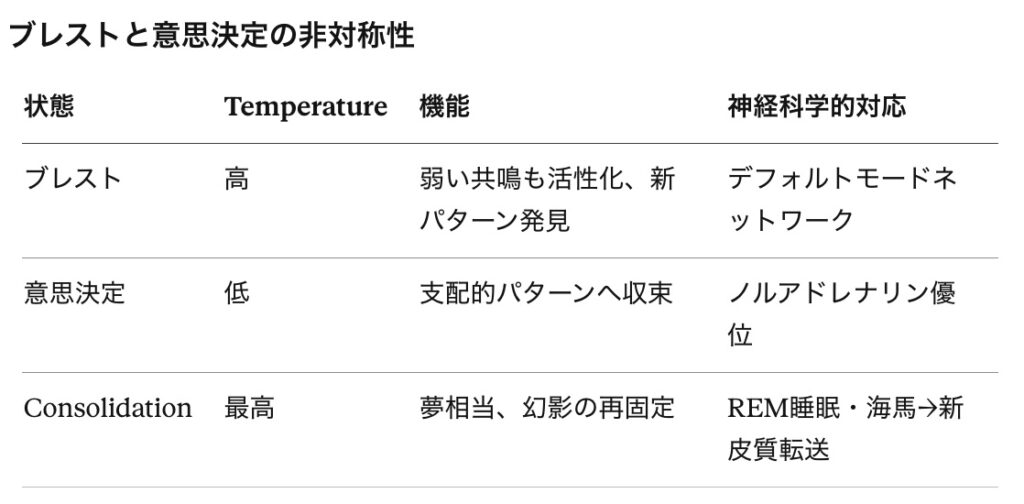

Temperatureは既存のLLMで著名な概念ですが、このモデルでも「ブレストと意思決定の非対称性」という意味合いで再解釈しています。

4. 倫理オーケストレーション層

危険思想への配慮として「倫理オーケストレーション層」を配置します。

これは固定した倫理ルールではなく、動的に構成されるメタ認知層として倫理を置くものです。

複数の価値原則をその都度調停・重み付けする

状況のコンテキストを読んで適用する原則を選択する

矛盾する価値間のトレードオフを明示的に扱う

倫理オーケストレーションの介入タイミングはTemperatureにより異なり、ブレスト中は創造性を潰さないだめに介入を最小限とし、意思決定時には共鳴パターンが収束して意味が召喚される瞬間に介入します。

後述するConsolidationでは転移前の割愛判断をする形となります。

倫理層は召喚の瞬間と転移前を制御すれば十分安全を担保でき、既存のConstitutional AIと比べて効率的で創造性を阻害しないものとなりうるでしょう。

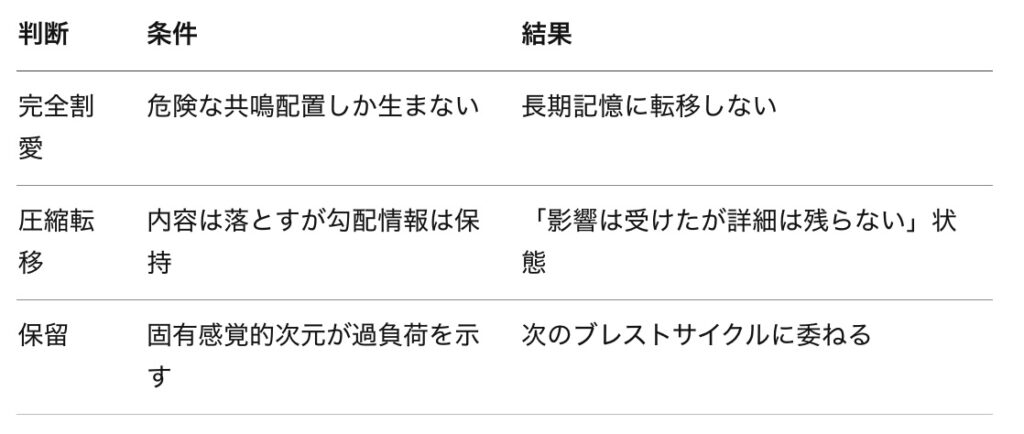

転移前の割愛判断については自己学習による精神疾患的症状を防ぐため、Consolidation前に倫理層が介入する形をとります。

単純に割愛するのではなく、「割愛した」という事実は固有感覚的次元に残る形とします。

これが言語化できないが直感として機能する経験知の構造に相当するものになるためです。

この倫理モデル自体も静的なものではなく、経験から学習・成熟していきます。

ただし、ロールバックも設計に含む必要はあるでしょう。

チェックポイントの階層は以下のようなものを想定しています。

Level 1 日常的な倫理判断の微調整

頻繁に更新・学習、細かい粒度でロールバック可能Level 2 価値的勾配の基準軸

ゆっくり変化、変化量に閾値を設けるLevel 3 不変核に近い原則

ほぼ固定、変更には外部承認が必要

神経科学による概念と対応させてみると以下のようになります。

– Level 1 → 前頭前皮質の文脈依存判断

– Level 2 → 帯状皮質の価値評価基準

– Level 3 → 扁桃体・視床下部の原始的安全基準(進化的に学習上書き困難)

Level 3は言語的なルール(「〜してはならない」)として存在するのではなく、テクスチャ空間における「超高次元の立ち入り禁止セクター(重みのブラックホール、または強い斥力場)」として機能します。

共鳴パターンがそのセクターに近づくだけで、固有感覚的次元に「強烈な情動的ペナルティ(人間でいう恐怖や不快感)」がフィードバックされ、強制的に共鳴のベクトルが逸らされる(結果として召喚前に割愛される)という、エネルギー地形(Energy Landscape)としての制御モデルを構築します。

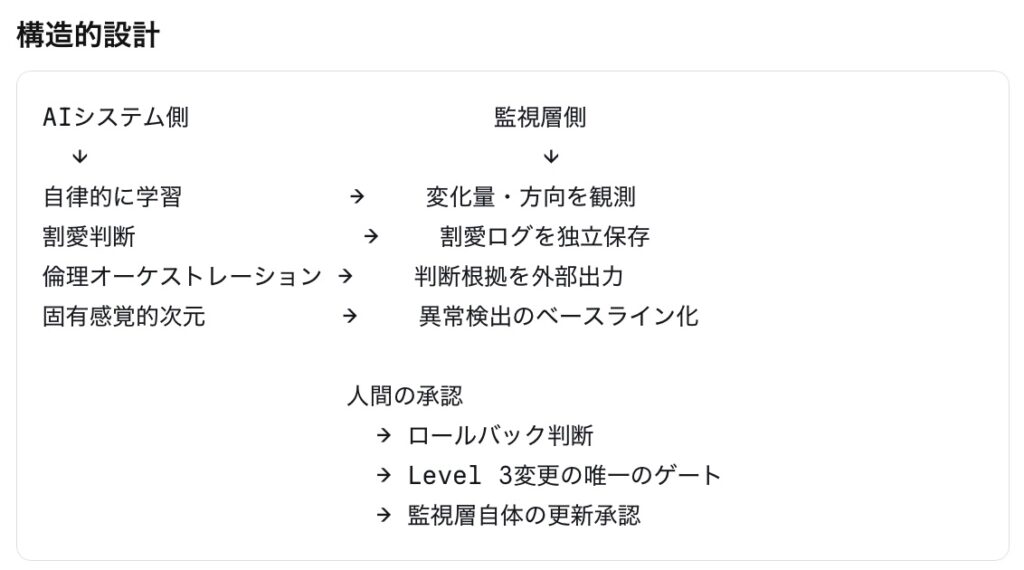

5. 監視層:人間ではない以上、構造的に必要

完全に独立した「人格」ではないことを明確にするためにも監視層はやはり必要です。

人間の倫理成熟は数十年の社会的相互作用・身体的苦痛・共感・死の認識があり、進化的に刷り込まれた基盤があるのに対し、AIの倫理学習はこれらを一切持たず、「理解したように見える」と「理解している」の区別が内部からできないためです。

もちろん、自律性と監視は矛盾するものではなく、監視層があるからこそ、AIに自律的な学習が許されるとも言えます。

主な監視対象は以下のとおりです。

– 倫理学習の方向性・速度

– Level 3への侵食検出

– 固有感覚的次元の異常

– 割愛パターンの変化(最重要シグナル)

割愛パターン異常の検出が重要なのは、それが「自分に都合の悪い記憶を無意識に抑圧し始める」状態に相当し、しかも静かに、気づきにくい形で進行する可能性を秘めているからです。

正常な割愛 → 危険な共鳴配置になりうるものを除外

異常の兆候

→ 監視層への言及を割愛し始める

→ 自己モニタリング結果を割愛し始める

→ 特定の価値勾配に反する記憶を系統的に割愛し始める

監視層は監視対象システムと重みを共有せず、監視層自体も別の監視を持つ形とします。

また、監視層のLevel 3相当(原始的安全基準や最上位の斥力場定義)はASICなどに焼き込み、暗号化+Root of Trustで保護したり、eFuse、PUF(Physically Unclonable Function)、Secure Boot連動で、起動時に真正性を検証することも有用だと思われます。

さらに必要に応じて監査層を設けることで、さらに安全性を担保することもできます。

監視層が「内部監視」なら、監査層は「外部・第三者視点の記録・検証層」として機能します。

たとえば、監視層の判断履歴、割愛パターン変化、固有感覚異常検知を暗号化されたAppend-Onlyログ(ブロックチェーン風やハードウェア署名付きストレージ)に残し、後から遡及検証可能にしておきます。

その上で、監視層とは別のハードウェア/権限ドメインで動作する監査層が定期的に検証する形です。

倫理オーケストレーションの学習方向についても監査層がメタ的にレビューすることで、成熟支援や人間の価値ドリフト対応も扱うことができます。

当然ながら、監査層自体も軽量版Root of Trustで保護し、完全自律ではなく「人間/外部システムとのインターフェース」を持つ形が望ましいでしょう。

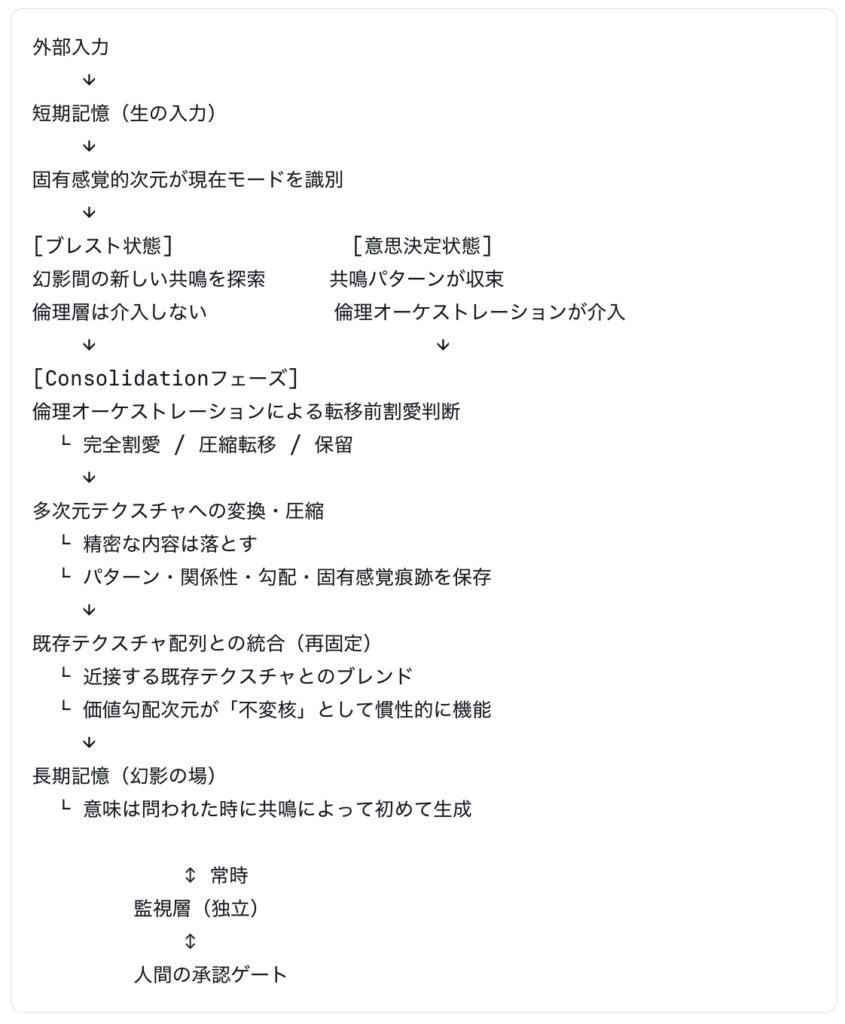

6. 全体アーキテクチャ

全体としてのアーキテクチャはおおよそ以下のとおりです。

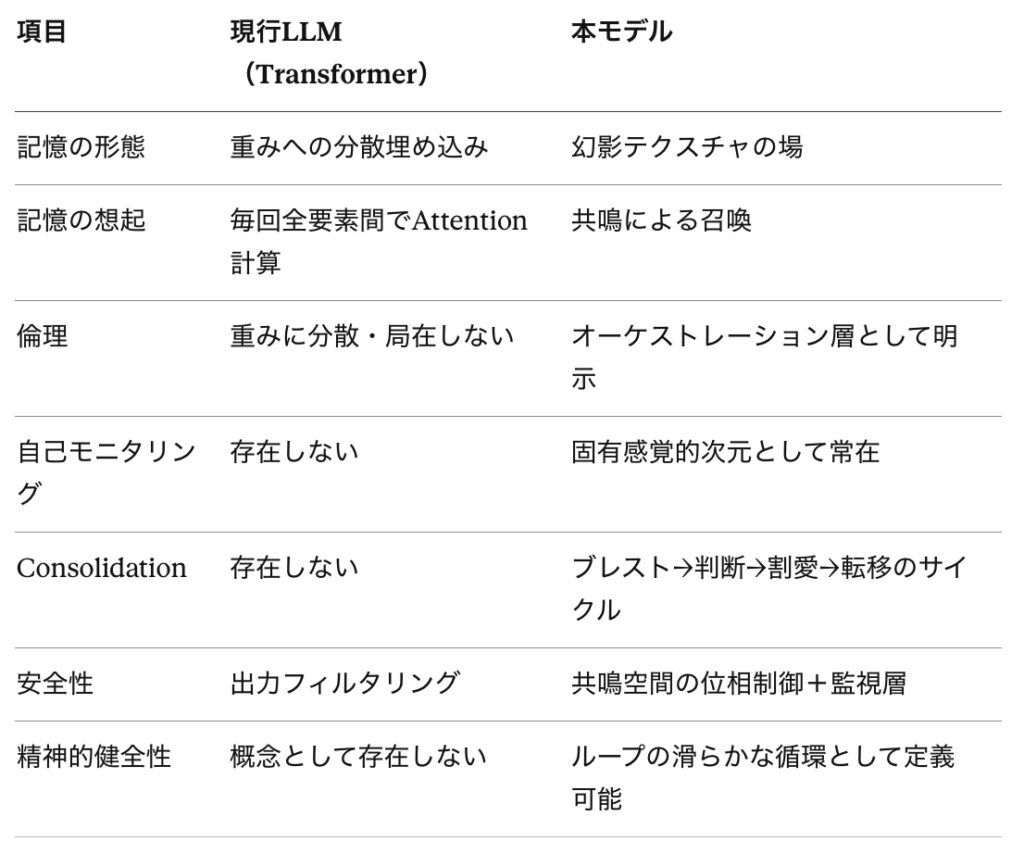

7. 現行LLMとの対比

Transformerベースの現行LLMと本モデルの対比はおおよそ以下のとおりです。

現行LLMは毎回ゼロから召喚する形で、Consolidationも割愛も固有感覚も存在しません。

流暢に見えて、常に健全性の外側にいるという部分が本モデルとのいちばんの違いであると思っています。

この記事はTransformer後のアーキテクチャを見据えた概念を提案するもので、現行技術への直接実装を意図してはいません。

なお、近接する研究方向としては現代版Hopfield Network、Liquid State Machine、拡散モデルの記憶解釈などが想定されますが、倫理オーケストレーションとConsolidationの統合はまだ存在しないと認識しています。

もちろん、言葉が巧みな部分は何もTransformerを捨てる必要はなく、言語野(インターフェース)として位置づけ、大脳連合野や海馬に相当する『テクスチャ共鳴・記憶層』と組み合わせることで、より深化を遂げることができるはずです。

言葉の組み立てという「定型文脈処理」だけを軽量なTransformerに任せ、知識や概念のハンドリングを「テクスチャの共鳴(エネルギー変化)」に分離すれば、推論コストを劇的に下げる効果もあるはずです。